해플라이 로보틱스, SIGGRAPH 2025에서 엔비디아 기술을 활용한 실시간 물리 AI 및 원격 작동 데모 공개

에서 시그라프 2025, 하플리 로보틱스 는 로봇 공학, 시뮬레이션 및 물리적 AI의 미래를 다음과 같은 체험형 데모를 통해 선보일 예정입니다. 엔비디아 옴니버스, 엔비디아 아이작 심(Isaac Sim)및 NVIDIA RTX 플랫폼으로 구동되는 데모를 시연합니다. 부스 #728을 방문하여 직관적인 햅틱과 강력한 시뮬레이션이 어떻게 결합되는지 Haply의 Inverse3X 컨트롤러와 라이브 키노바 로봇 팔을 통해 직접 체험해 보세요.

그 핵심에는 지능형 로봇을 위한 차세대 아키텍처인 쓰리 컴퓨터 솔루션이 있습니다:

휴먼 워크스테이션 - 실시간 햅틱 인터랙션, 고충실도 시뮬레이션, 몰입형 3D 그래픽을 위한 사용자 포털 역할을 하는 NVIDIA RTX GPU 기반의 데스크톱 또는 노트북입니다. 이 워크스테이션은 세계 최초의 안정적인 저주파 햅틱 인터랙션을 제공하는 Isaac Sim 고급 물리 모델링을 통해 사용자가 복잡한 저대역폭 환경에서도 전례 없는 사실감으로 가상 오브젝트를 느낄 수 있도록 해줍니다.

디지털 브레인 - NVIDIA Isaac Sim, Omniverse 및 NVIDIA Cosmos로 구동되는 디지털 브레인은 사실적인 렌더링 및 실제 물리학으로 시뮬레이션, AI 트레이닝 및 디지털 트윈 동기화를 오케스트레이션합니다. 이를 통해 풍부한 데모 데이터, 모방 학습, 휴먼 인 더 루프 강화 학습을 캡처할 수 있으며, NVIDIA Isaac GROOT와 같은 모델은 높은 수준의 동작 제어를 제공합니다. 이러한 NVIDIA 플랫폼을 함께 사용하면 개발자는 로봇 개발을 위한 확장 가능한 고속 인텔리전스 파이프라인을 구축할 수 있으며, 합성 데이터와 실제 데이터를 혼합하여 학습 주기를 가속화할 수 있습니다.

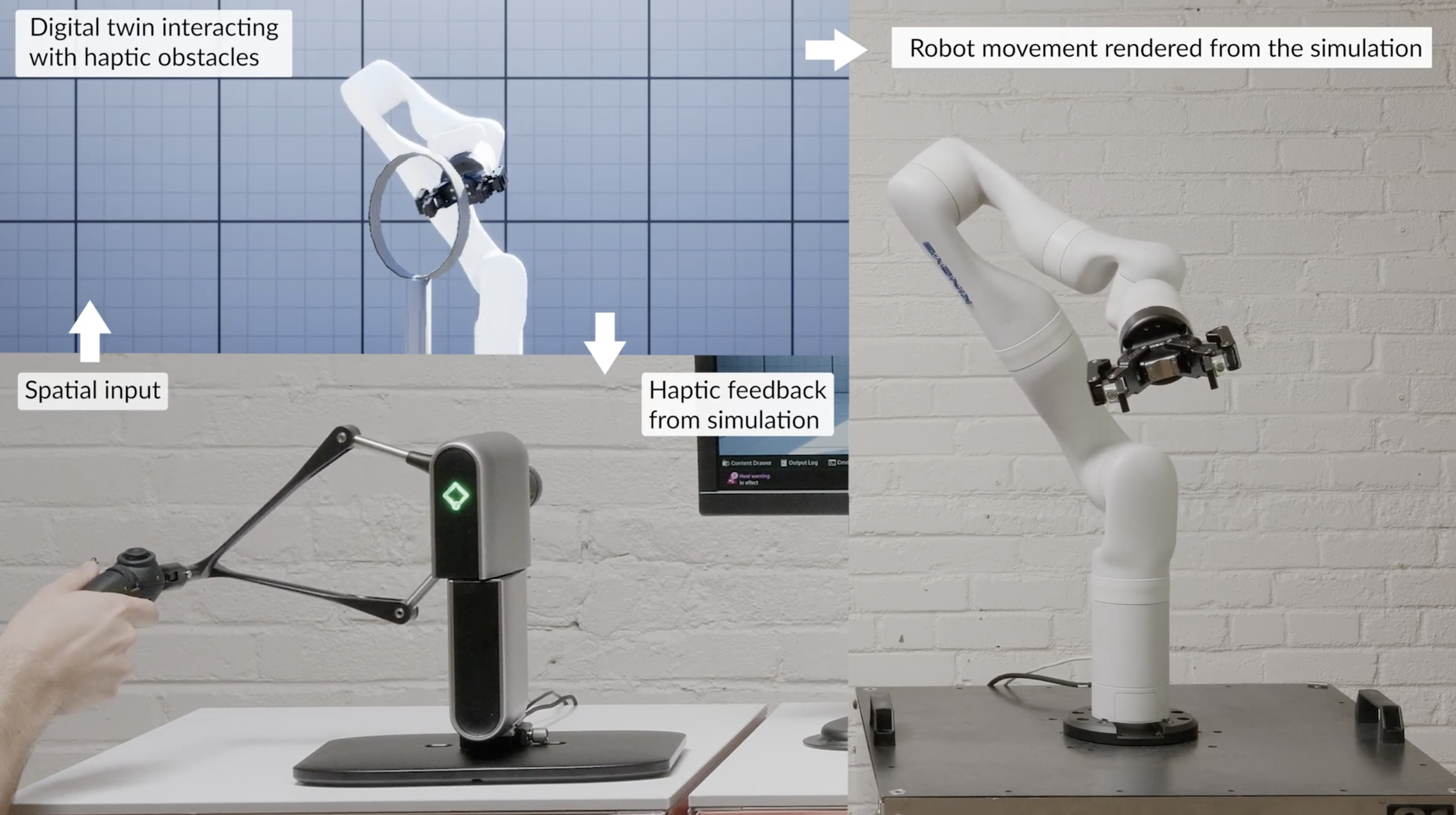

피지컬 머신 - 실제 원격으로 작동하는 로봇(예: 키노바 팔)으로, NVIDIA AI 및 시뮬레이션 스택을 통해 훈련 및 안내되며, Haply의 Inverse3X 디바이스를 통해 직관적으로 제어됩니다. 이 시스템은 사람의 동작과 힘 입력을 실시간으로 캡처하여 촉각 프로그래밍, 적응형 동작, 물리적 세계와 디지털 세계 간의 원활한 미러링을 지원합니다

이 시스템을 통해 사용자는 직관적으로 로봇을 제어하고, 모방 학습으로 AI 모델을 훈련하고, 물리적으로 사실적인 환경을 구축할 수 있으며, 모두 실시간 반응성으로 구현할 수 있습니다. Haply의 Inverse3X는 이 에코시스템에 대한 인간의 3D 인터페이스 역할을 하며 물리적 영역과 가상 영역 모두에 대한 터치, 동작, 의도를 캡처합니다.

데모 하이라이트

● 로봇 원격 조작 + 디지털 트윈 - 촉각 피드백으로 키노바 로봇을 제어하는 동시에 RTX에서 실행되는 Isaac Sim 기반의 디지털 트윈을 볼 수 있습니다.

이 시스템은 엔비디아 하드웨어와 소프트웨어를 사용하여 복잡한 운동학 및 햅틱 계산을 최대 10kHz로 수행하여 실제와 같은 상호작용과 지연 시간을 최소화합니다.

"우리는 엔비디아의 세 컴퓨터 솔루션의 3D 인간 인터페이스입니다." Haply Robotics의 공동 창립자 콜린 갤러처(Colin Gallacher)가 말했습니다. "가상 세계를 조각하든, 로봇을 프로그래밍하든, 터치를 통해 AI를 훈련하든, 우리는 공간적 상호 작용을 직관적으로 만듭니다."

부스 #728을 방문하여 체험해 보세요:

엔비디아 가속 실시간 디지털 트윈

● 원격 조작 로봇공학

● 아이작 심 + 옴니버스 통합

● 실제 및 합성 데이터를 사용한 확장 가능한 AI 트레이닝